Tạo ảnh bằng AI trên Zalo, đối tượng xấu có thể lợi dụng hình ảnh để lừa đảo

VOV.VN - Theo chuyên gia, sử dụng hình ảnh để làm nguồn huấn luyện cho AI tạo ra các hình ảnh dựa trên đặc điểm của người dùng. Với công nghệ này, khuôn mặt người dùng có thể bị lạm dụng để thực hiện cuộc gọi deepfake (gọi điện giả mạo khuôn mặt) để lừa đảo người thân.

Những ngày gần đây, cơn sốt khoe ảnh do trí tuệ nhân tạo (AI) quay trở lại trên các diễn đàn, mạng xã hội. Điều này thể hiện qua việc nhiều người dùng đã thay đổi avatar hay còn gọi là ảnh đại diện theo mẫu ảnh do AI định ra.

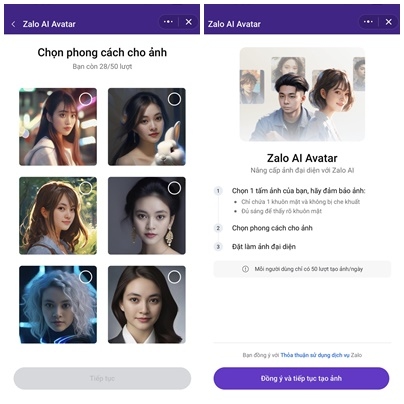

Được biết, những tấm ảnh này được tạo ra bởi Zalo AI Avatar - một chương trình trí tuệ nhân tạo do người Việt phát triển. Đây là mini app được tích hợp sẵn trên ứng dụng Zalo.

Những bức ảnh do Zalo Al tạo ra, được người dùng mạng xã hội đánh giá là giữ được các đường nét tự nhiên trên khuôn mặt.

Theo đó, người dùng chỉ cần tải ảnh lên app Zalo Al Avatar, sau đó vào mục đồng ý và tiếp tục tạo ảnh, chọn ảnh trên máy, chọn giới tính, độ tuổi. Phần mềm này sau đó sẽ hướng dẫn người chơi chọn phong cách cho ảnh.

Từ yêu cầu này, AI sẽ xử lý yêu cầu, tạo ra hàng loạt ảnh chân dung mới. Trung bình, mỗi lần chơi, người dùng có thể tạo ra 50 bức chân dung và lưu lại những bức làm mình hài lòng nhất. Con số này cho phép họ thử nghiệm rất nhiều kiểu tạo hình của bản thân ở các độ tuổi khác nhau.

Liên quan đến việc sử dụng trí tuệ nhân tạo, thời gian gần đây, nhiều chuyên gia về công nghệ luôn khuyến cáo người dùng về nguy cơ lọt dữ liệu cá nhân khi sử dụng các tính năng chỉnh sửa ảnh bằng AI được cung cấp trên mạng xã hội. Theo các chuyên gia, ảnh chụp bằng điện thoại di động thường sẽ có thêm các thông tin về thời gian, loại điện thoại đang dùng và vị trí chụp bức ảnh, từ đó có thể tổng hợp ra thói quen, lịch trình hoạt động, di chuyển của người dùng. Việc cung cấp ảnh chân dung của chính mình cũng tạo nguy cơ bị lợi dụng để tạo ra ảnh giả mạo, video giả mạo nếu chúng lọt vào tay kẻ xấu.

Về vấn đề này, anh Nguyễn Hưng- CoFounder (đồng sáng lập) dự án Chống lừa đảo trên không gian mạng khẳng định, hoàn toàn có thể xảy ra việc người người chơi bị các đối tượng xấu lợi dụng hình ảnh để lừa đảo. Bởi, việc chỉnh sửa ảnh bằng AI đòi hỏi người dùng phải đăng tải hình ảnh gốc của mình lên công cụ làm nguồn để chỉnh sửa. Phía máy chủ của ứng dụng có thể lưu lại hình ảnh này và dẫn đến các nguy cơ sau đây:

Theo anh Hưng, đầu tiên là lộ lọt thông tin cá nhân. Bởi, các hình ảnh khi chụp đôi khi có dính các thông tin định danh như địa chỉ nhà, biển số xe, nơi làm việc, vị trí làm việc... việc thu thập các thông tin này cùng với các thông tin công khai khác sẽ giúp đối tượng xây dựng được chân dung hoàn chỉnh về người dùng và dễ dàng giả mạo họ.

Thứ 2 là lộ lọt vị trí địa lý. Về vấn đề này, anh Hưng cho rằng, các thiết bị khi chụp ảnh thường tự động chèn các thông tin liên quan đến thiết bị, vị trí vào tấm hình (được gọi là thông tin Geotag, metadata). Các thông tin này bao gồm: thông tin GPS chính xác (longitude, latitude) giúp xác định vị trí tấm ảnh được chụp, ngày giờ chụp, thiết bị chụp...

“Vấn đề thứ 3, người chơi bị sử dụng hình ảnh trái phép. Các đối tượng lừa đảo có thể sử dụng hình ảnh định danh của người chơi, cùng các thông tin thu thập được để tạo nên các giấy tờ xác minh giả, vượt qua quá trình xác minh trực tuyến để khôi phục quyền truy cập tài khoản, tạo tài khoản giả mạo, hình ảnh, tin tức giả mạo.... Cùng với sự phát triển của AI, các đối tượng dễ dàng dùng khuôn mặt của người dùng để cắt ghép tạo thành các hình ảnh giả mạo, tạo nên các tin tức giả mạo, bôi nhọ, xuyên tạc, khiêu dâm, lừa đảo”- anh Nguyễn Hưng nói.

Sử dụng hình ảnh để làm nguồn huấn luyện cho AI tạo ra các hình ảnh dựa trên đặc điểm của người dùng, với công nghệ này, anh Hưng cho rằng, khuôn mặt người dùng có thể bị lạm dụng để thực hiện cuộc gọi deepfake (gọi điện giả mạo khuôn mặt) để lừa đảo người thân. Hiện, Microsoft cũng đã có công nghệ bắt chước giọng nói, chỉ cần vài giây giọng nói AI có thể bắt chước và tạo ra giọng nói tương tự người thật. Khi kết hợp với Deepfake sẽ tạo ra một cuộc gọi giả mạo nạn nhân toàn vẹn.

"Cùng với đó là xây dựng profile giả mạo của nạn nhân. Bởi, công nghệ AI hiện tại (stable diffusion) đã cho phép người dùng tạo ra các hình ảnh giả mạo các hoạt động sinh hoạt của người bình thường. Đối tượng có thể tận dụng điều này kết hợp với các thông tin định danh khác để tạo ra 1 profile tương tự như nạn nhân và có các hoạt động sinh hoạt như bình thường. Qua đó, lừa đảo người thân hoặc dùng vào các mục đích xấu"- anh Hưng phân tích.

Việc tạo ảnh bằng AI trên Zalo, anh Nguyễn Hưng khẳng định, mặc dù Zalo AI Avatar được phát triển bởi tập đoàn công nghệ lớn và uy tín của Việt Nam, đây là điều đáng mừng và đáng tự hào cho nước nhà. Zalo hoạt động tại Việt Nam và luôn tuân thủ theo các pháp luật hiện hành, cho nên người dùng có thể an tâm.

Tuy nhiên, với những ứng dụng tương tự của nước ngoài, người dùng cần hết sức cân nhắc và phải tìm hiểu rõ về đơn vị chủ quản, đánh giá uy tín của họ trước khi quyết định cung cấp thông tin. Việc cung cấp các thông tin cá nhân cho bên thứ ba luôn tồn tại những rủi ro khó có thể lường trước được.

Do đó, người dùng cần cân nhắc, nếu không thật sự cần thiết thì nên hạn chế cung cấp các thông tin liên quan đến định danh cá nhân.